N° 184

SÉNAT

SESSION ORDINAIRE DE 2019-2020

|

Enregistré à la Présidence du Sénat le 10 décembre 2019 |

AVIS

PRÉSENTÉ

au nom de la commission des affaires économiques (1) sur la proposition de loi , adoptée par l'Assemblée nationale après engagement de la procédure accélérée, visant à lutter contre les contenus haineux sur internet ,

Par M. Yves BOULOUX,

Sénateur

|

(1) Cette commission est composée de : Mme Sophie Primas , présidente ; Mme Élisabeth Lamure, MM. Daniel Gremillet, Alain Chatillon, Martial Bourquin, Franck Montaugé, Mmes Anne-Catherine Loisier, Noëlle Rauscent, M. Alain Bertrand, Mme Cécile Cukierman, M. Jean-Pierre Decool , vice-présidents ; MM. François Calvet, Daniel Laurent, Mmes Catherine Procaccia, Viviane Artigalas, Valérie Létard , secrétaires ; M. Serge Babary, Mme Anne-Marie Bertrand, MM. Yves Bouloux, Bernard Buis, Henri Cabanel, Mmes Anne Chain-Larché, Marie-Christine Chauvin, Catherine Conconne, Agnès Constant, MM. Roland Courteau, Pierre Cuypers, Marc Daunis, Daniel Dubois, Laurent Duplomb, Alain Duran, Mmes Dominique Estrosi Sassone, Françoise Férat, M. Fabien Gay, Mme Annie Guillemot, MM. Xavier Iacovelli, Jean-Marie Janssens, Joël Labbé, Mme Marie-Noëlle Lienemann, MM. Pierre Louault, Michel Magras, Jean-François Mayet, Franck Menonville, Jean-Pierre Moga, Mmes Patricia Morhet-Richaud, Sylviane Noël, MM. Jackie Pierre, Michel Raison, Mmes Évelyne Renaud-Garabedian, Denise Saint-Pé, M. Jean-Claude Tissot . |

Voir les numéros :

|

Assemblée nationale ( 15 ème législ.) : |

1785 , 1989 , 2062 et T.A. 310 |

|

|

Sénat : |

645 (2018-2019) et 173 (2019-2020) |

|

L'ESSENTIEL

Réunie le mardi 10 décembre 2019, sous la présidence de Mme Sophie PRIMAS , la commission des affaires économiques a examiné le rapport de M. Yves BOULOUX sur les articles dont elle s'est saisie pour avis simple de la proposition de loi visant à lutter contre les contenus haineux sur internet 1 ( * ) , adoptée par l'Assemblée nationale après engagement de la procédure accélérée.

Si le phénomène est encore peu documenté, chaque utilisateur des réseaux sociaux peut aujourd'hui constater que les propos haineux répréhensibles par la loi s'y répandent quotidiennement. La question que pose cette proposition de loi est donc pleinement légitime. Mais la réponse qu'elle y apporte apparaît inaboutie.

La commission des affaires économiques s'est saisie de ce texte pour avis simple car il modifie la loi pour la confiance dans l'économie numérique de 2004 - dite « LCEN », dont elle avait été saisie au fond. De plus, si son objectif relève de la protection des libertés fondamentales, il affecte l'économie numérique, qui relève de la compétence de la commission.

La commission partage la démarche adoptée en l'espèce par le Gouvernement, qui consiste à faire de la France un laboratoire européen et mondial, sans attendre que des dispositions soient adoptées au niveau européen.

Elle soutient également les dispositions moins commentées - mais sans doute plus pertinentes -, qui visent à instaurer une régulation ex ante des plateformes en matière de lutte contre les contenus illicites. C'est pourquoi elle s'est attachée à en accroître l'efficacité.

La commission appuie en revanche les doutes de la commission des lois du Sénat sur la pertinence de la « disposition phare » du texte, à savoir son article premier, au regard des risques qu'elle fait peser sur la liberté d'expression.

À l'initiative de son rapporteur, la commission a adopté les amendements suivants, qui visent à :

- doter le régulateur d'un pouvoir d'évocation pour les plateformes sous les seuils amenés à être déterminés par décret, afin d'éviter un report des utilisateurs tenant des propos illicites vers des plateformes non régulées ;

- proportionner les obligations de moyen en fonction de la capacité des acteurs et du risque d'atteinte à la dignité humaine ;

- supprimer une disposition s'assimilant à une obligation générale de surveillance, afin de rendre le texte conforme au droit européen actuellement en vigueur ;

- permettre au régulateur d'encourager les acteurs concernés au partage d'informations .

Sous réserve de l'adoption de ses amendements, la commission a émis un avis favorable à l'adoption des articles de la proposition de loi dont elle s'est saisie pour avis.

Les amendements ont été examinés par la commission des lois lors de sa réunion du mercredi 11 décembre 2019.

I. UNE PERSISTANCE DÉPLORABLE DES DISCOURS DE HAINE EN LIGNE MALGRÉ L'EXISTENCE D'UN ARSENAL JURIDIQUE NON NÉGLIGEABLE

A. LE DROIT EN VIGUEUR ALLIE RESPONSABILITÉ EN L'ABSENCE DE PROMPT RETRAIT ET AUTO-RÉGULATION

1. La responsabilité des hébergeurs peut-être engagée en cas d'absence de prompt retrait d'un contenu illicite dûment notifié

Le droit applicable aux contenus publiés sur internet est issu de la directive sur le commerce électronique (ou directive « e-commerce »), adoptée en 2000 2 ( * ) , qui avait pour double objectif de favoriser le développement de l'économie numérique sur le marché intérieur en évitant d'imposer des contraintes trop lourdes aux intermédiaires et de préserver la liberté d'expression en ligne 3 ( * ) . Elle a été transposée en 2004 par l'article 6 de la loi pour la confiance dans l'économie numérique (ci-après, « LCEN ») 4 ( * ) , ultérieurement complétée d'un article 6-1 5 ( * ) .

En application de cet article 6, les hébergeurs 6 ( * ) sont tenus de retirer « promptement » les contenus illicites qui leur ont été notifiés dans les formes déterminées par la loi, sous peine d'engager leur responsabilité civile et pénale . Ce régime concerne tout type d'illicéité : contenus « haineux », mais aussi violation de droits d'auteurs, trafics illicites, fraude...

|

La responsabilité « limitée » des hébergeurs La LCEN distingue trois régimes de responsabilité (civile et pénale) : - un régime d' irresponsabilité des fournisseurs d'accès à internet (FAI) 7 ( * ) à raison des contenus qu'ils transportent ; - un régime allégé, qui concerne les hébergeurs à raison des contenus qu'ils hébergent, car ils sont considérés comme des intermédiaires techniques, dont l'activité se limite à rendre disponibles des contenus publiés par d'autres ; - un régime de responsabilité des éditeurs 8 ( * ) , qui choisissent les contenus publiés. S'agissant des hébergeurs, cela signifie, selon l'article 6 de la LCEN, qui découle des articles 14 et 15 de la directive sur le commerce électronique, que : - leur responsabilité (civile ou pénale) ne peut être engagée (i) s'ils n'avaient pas « effectivement » connaissance du caractère illicite du contenu « ou de faits et circonstances faisant apparaître ce caractère » ou si, (ii) « dès le moment où ils en ont eu connaissance, ils ont agi promptement pour retirer ces données ou en rendre l'accès impossible ». L'hébergeur est considéré avoir pris connaissance effective du caractère illicite de l'information stockée à partir du moment où une notification lui a été remise, dans des conditions de forme déterminées par la loi (la notification doit, en particulier, permettre d'identifier le notifiant, et de justifier d'une demande de retrait préalable adressée à l'éditeur ou à l'auteur du propos jugé illicite). Toute notification abusive est punie d'une peine pouvant aller jusqu'à un an d'emprisonnement et 15 000 euros d'amende). Dans sa décision n° 2004-496 DC du 10 juin 2004, le Conseil constitutionnel a de plus limité la portée de cette responsabilité, en indiquant que le contenu devait présenter un caractère manifestement illicite ; - ne pèse sur eux aucune obligation de surveillance générale des informations qu'ils stockent, ni aucune obligation générale de rechercher activement des faits ou des circonstances révélant des activités illicites. |

La LCEN prévoit également la possibilité pour l'autorité judiciaire de prescrire en référé ou sur requête toutes mesures permettant de prévenir un dommage ou de faire cesser un dommage occasionné par tout contenu illicite 9 ( * ) , autrement dit, elle autorise un blocage judiciaire de l'accès au contenu - l'autorité judiciaire pouvant s'adresser à l'hébergeur ou, à défaut, au fournisseur d'accès à internet (FAI) 10 ( * ) . La nécessité de s'adresser d'abord à l'hébergeur est connue sous le nom de « principe de subsidiarité ». Ce dernier a fait l'objet d'une interprétation relativement souple de la Cour de cassation 11 ( * ) , sans toutefois le priver de toute portée 12 ( * ) .

Enfin, les hébergeurs et FAI doivent prendre les mesures nécessaires pour conserver les données de nature à permettre l'identification de quiconque aurait contribué à la création du contenu illicite. Les autorités judiciaires peuvent, en effet, être amenées à souhaiter consulter lesdites données.

S'agissant des contenus « haineux » 13 ( * ) , la LCEN prévoit déjà des obligations renforcées à la charge des hébergeurs 14 ( * ) . Les hébergeurs et FAI doivent à ce titre :

- prévoir un dispositif de signalement « facilement accessible et visible » permettant à toute personne de porter à leur connaissance ce type de données ;

- informer « promptement » les autorités publiques compétentes de toutes activités illicites qui leur seraient signalées et qu'exerceraient les destinataires de leurs services - le signalement est traité par la plateforme Pharos 15 ( * ) , qui dépend de l'Office central de lutte contre la criminalité liée aux technologies de l'information et de la communication (OCLCTIC) du ministère de l'Intérieur ;

- rendre publics les moyens qu'elles consacrent à la lutte contre ces activités illicites.

Contrairement à l'absence de retrait du contenu dans un délai prompt, le fait de ne pas remplir ces obligations est un délit en tant que tel , passible d'un an d'emprisonnement et de 75 000 euros d'amende (375 000 euros d'amende pour une personne morale).

Pour certains types de contenus haineux illicites publiés en ligne 16 ( * ) , l'article 50-1 de la loi du 29 juillet 1881 sur la liberté de la presse prévoit également la possibilité d'un blocage judiciaire en référé en cas de « trouble manifestement illicite » 17 ( * ) .

Enfin, depuis 2014, pour les contenus terroristes ou pédopornographiques, un dispositif de blocage administratif s'appuyant sur les fournisseurs d'accès à internet a été mis en place à l'article 6-1 de la LCEN. En cas de non-respect de la demande de blocage par les FAI, ceux-ci s'exposent à une peine d'un an d'emprisonnement et 75 000 euros d'amende pour les personnes physiques (portée à 375 000 euros pour les personnes morales). Pour simplifier, le mécanisme tient en deux temps :

- d'abord, l'autorité administrative - en l'occurrence l'OCLCTIC - demande à l'éditeur du service ou à son hébergeur « de retirer les contenus » ; elle en informe simultanément les FAI ;

- en l'absence de retrait dans les 24 heures, l'OCLCTIC peut notifier ces contenus aux FAI, qui « doivent alors empêcher sans délai l'accès à ces adresses » .

Par précaution, le législateur a prévu que la mesure de blocage est placée sous le contrôle d'« une personnalité qualifiée, désignée en son sein par la Commission nationale de l'informatique et des libertés » (Cnil).

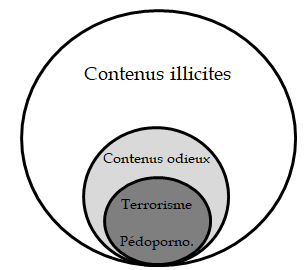

Représentation simplifiée des différents champs d'application des dispositions de la LCEN

Le droit en vigueur a fait l'objet d'un utile rappel de la ministre de la Justice dans une circulaire en date du 4 avril 2019 portant sur la lutte contre les discriminations, les propos et les comportements haineux.

2. Au-delà de la directive « e-commerce », la préférence européenne pour l'auto-régulation

Au-delà des dispositions en vigueur décrites au 1. et qui découlent en partie de la directive sur le commerce électronique, la Commission européenne favorise, sur ce sujet, une approche non coercitive. Celle-ci repose sur un code de conduite visant à lutter contre les discours haineux illégaux en établi en juin 2016. Il ne s'agit pas d'un texte officiel de l'UE, mais d'engagements pris par les grandes entreprises de l'Internet 18 ( * ) , encouragées par les autorités européennes.

|

Les engagements volontaires des entreprises figurant dans le code de conduite Figurent notamment dans le code de conduite les engagements suivants : - mettre en place des procédures claires et efficaces d'examen des signalements de discours haineux illégaux (ou non conformes aux règles d'utilisation) ; - confier le soin d'examiner le caractère illégal du contenu après signalement à des équipes spécialisées ; - examiner « la majorité des signalements » valides en moins de 24 heures et, s'il y a lieu, en bloquer l'accès ; - informer leurs utilisateurs et les sensibilisent aux types de contenus qui ne sont pas autorisés ; - fournir des informations sur les procédures et leur mise en oeuvre (signalement, blocage, retrait) ; - établir un point de contact dans chaque État membre pour échanger ces informations ; - favoriser la coopération dans la lutte contre les contenus haineux avec des associations en tant que « signaleurs de confiance », ou « trusted flaggers » ; en France, la DILCRAH (Délégation Interministérielle à la Lutte Contre le Racisme, l'Antisémitisme et la Haine anti-LGBT) et de nombreuses associations sont considérées comme « rapporteurs de confiance » ; - former leur personnel « aux évolutions actuelles de la société » ; - échanger les bonnes pratiques ; - promouvoir des contre-discours et des programmes éducatifs favorisant l'esprit critique. |

En mars 2018, la Commission a également formulé une recommandation sur « les mesures destinées à lutter, de manière efficace, contre les contenus illicites en ligne » 19 ( * ) , qui met en avant quelques grands principes et bonnes pratiques pour lutter contre les contenus illicites. Dans la foulée, la Commission a lancé une consultation sur la régulation des contenus illicites en ligne, afin d'apprécier, secteur par secteur, l'opportunité de renforcer la réglementation.

Plusieurs textes de nature contraignante viennent cependant compléter cette approche centrée sur l'autorégulation . La récente directive modifiant les règles applicables aux services de médias audiovisuels, dite « SMA », que la France n'a pas encore transposée, prévoit que les États doivent veiller à ce que les plateformes de partage de vidéos établies sur leur territoire prennent les mesures appropriées pour protéger « le grand public des programmes vidéos créés par l'utilisateur et communications commerciales audiovisuelles comportant des contenus dont la diffusion constitue une infraction pénale au titre du droit de l'Union », notamment les infractions relevant du racisme et de la xénophobie 20 ( * ) . Elle privilégie cependant assez largement « l'utilisation de la corégulation et la promotion de l'autorégulation au moyen de codes de conduite ».

La proposition de règlement relatif à la prévention de la diffusion de contenus à caractère terroriste en ligne 21 ( * ) adopte une approche davantage coercitive en exigeant des hébergeurs de prendre des mesures pour lutter contre la diffusion de ces contenus, à publier des rapports de transparence et à insérer leur politique de prévention dans leurs conditions commerciales. La mesure « phare » du règlement consiste en une obligation de retrait du contenu en une heure à compter de la réception d'une injonction administrative.

Enfin, la nouvelle commission européenne entend ouvrir le chantier d'un « Digital services Act » qui pourrait amener à une révision de la directive « e-commerce » elle-même, mais le processus n'en est encore qu'aux prolégomènes.

Au niveau international, une charte non contraignante pour un internet ouvert, libre et sûr a été signée par les grands réseaux sociaux lors du G7 qui s'est tenu à Biarritz en août dernier suite à l'Appel de Christchurch du 15 mai 2019 22 ( * ) .

|

La charte pour un internet ouvert, libre et sûr d'août 2019 On peut notamment relever, eu égard à la proposition de loi, les engagements suivants de la part des réseaux sociaux et plateformes numériques signataires : - établir des procédures simples, facilement accessibles, transparentes et efficaces de traitement et de notification des contenus illégaux, le cas échéant en collaboration avec les autorités administratives ; - examiner ces notifications dans les plus brefs délais et prendre rapidement les mesures appropriées ; - mettre à disposition en temps voulu des mécanismes de recours efficaces en cas de retrait ou de désactivation de contenus, et prendre des mesures de sauvegarde adéquates pour protéger la liberté d'expression, notamment en faisant preuve de transparence vis-à-vis des utilisateurs concernant les contenus supprimés et en les rétablissant en cas de décision erronée. La possibilité d'autres recours, notamment judiciaires, ne saurait nullement être entravée ; - accroître la transparence de leurs conditions d'utilisation, de leurs activités liées au retrait de contenus, et des procédures de modération. |

* 1 La saisine de la commission des affaires économiques concernait les articles 1 er , 1 er bis, 1 er ter A, 1 er ter, 2, 3, 4, 5 et 6.

* 2 Directive 2000/31/CE du Parlement européen et du Conseil du 8 juin 2000 relative à certains aspects juridiques des services de la société de l'information, et notamment du commerce électronique, dans le marché intérieur.

* 3 Comme le souligne le Professeur Laure Marino dans le fascicule du jurisclasseur sur les responsabilités civile et pénale des fournisseurs d'accès et d'hébergement, « l'absence d'obligation de surveillance mise à la charge des prestataires nous met à l'abri d'une censure privée, réalisée sans intervention du juge . L'allégement de la responsabilité des prestataires est légitimé par leur entière neutralité au regard des contenus qu'ils stockent. Dans cet esprit, la liberté d'expression est une liberté individuelle dont les abus doivent par principe être assumés par les créateurs des contenus (l'inverse conduirait en outre à déresponsabiliser les citoyens) ».

* 4 Loi n° 2004-575 du 21 juin 2004 pour la confiance dans l'économie numérique.

* 5 Créé par la loi n° 2014-1353 du 13 novembre 2014 renforçant les dispositions relatives à la lutte contre le terrorisme.

* 6 Il s'agit, selon la LCEN, des « personnes physiques ou morales qui assurent, même à titre gratuit, pour mise à disposition du public par des services de communication au public en ligne, le stockage de signaux, d'écrits, d'images, de sons ou de messages de toute nature fournis par des destinataires de ces services ». Les services de communication au public en ligne restent des hébergeurs tant qu'ils ne jouent pas un « rôle actif de nature à leur confier une connaissance ou un contrôle des données stockées », critère s'appréciant au cas par cas (Cour de justice de l'Union européenne, 23 mars 2010, Google Adwords).

* 7 Selon l'article L. 32-3-3 du Code des postes et des communications électroniques, les « personnes dont l'activité est d'offrir un accès à des services de communication au public en ligne » (ex. : Orange, SFR, Bouygues Télécoms, Free) ne peuvent être tenues responsables des contenus qu'elles transportent, sauf « dans les cas où soit elle est à l'origine de la demande de transmission litigieuse, soit elle sélectionne le destinataire de la transmission, soit elle sélectionne ou modifie les contenus faisant l'objet de la transmission ».

* 8 Selon la LCEN, il s'agit des « personnes dont l'activité est d'éditer un service de communication au public en ligne ».

* 9 En l'occurrence, comme le précise une circulaire du ministère de la Justice en date du 4 avril 2019, « le dommage auquel il peut être mis fin consiste dans le fait de propager des contenus constituant une ou plusieurs infractions incriminées par la loi du 29 juillet 1881 ».

* 10 Ce dispositif a été étendu aux fournisseurs d'un service téléphonique au public par l'article L. 524-3 du code de la consommation. Il existe également un dispositif spécifique en matière de défense des droits d'auteur sur internet prévu à l'article L. 336-2 du Code de la propriété intellectuelle. Il convient également de rappeler que le référé de droit commun prévu par l'article 809 du code de procédure civile est aussi un outil susceptible d'être mobilisé.

* 11 Cour de cassation, Civ. 1 ère , 19 juin 2008, n° 07-12.244, qui estime que la prescription du blocage au fournisseur d'accès « n'est pas subordonnée à la mise en cause préalable des prestataires d'hébergement ».

* 12 TGI Paris, Ordonnance de référé en date du 27 novembre 2018, n° RG 18/58881, qui s'attache néanmoins à ce que soit démontré, dans l'acte introductif d'instance, qu'aucune action efficace n'a pu être engagée contre l'hébergeur, l'éditeur ou l'auteur du contenu litigieux.

* 13 Il s'agit des infractions visées aux cinquième, septième et huitième alinéas de l'article 24 de la loi du 29 juillet 1881 sur la liberté de la presse et aux articles 222-33, 225-4-1, 225-5, 225-6, 227-23, 227-24 et 421-2-5 du code pénal.

* 14 On notera que, depuis 2007, afin de lutter contre les activités illégales de jeux d'argent, les hébergeurs et FAI doivent mettre en place un « dispositif facilement accessible et visible » d'information du caractère illégal des jeux d'argent en ligne à destination des utilisateurs du service.

* 15 Pour « plateforme d'harmonisation, d'analyse, de recoupement et d'orientation des signalements ». D'abord fermée et centrée sur la problématique de la pédopornographie, elle s'est ensuite ouverte au public à travers la création d'un portail en 2009 (internet-signalement.gouv.fr) et son champ de compétence s'est étendu à l'ensemble des contenus illicites publiés en ligne. Elle comprend 80 personnes dont six enquêteurs dans la cellule dédiée aux discours de haine mise en place en 2015. Elle assure le traitement des signalements, initie les enquêtes judiciaires subséquentes et réalise en fonction de l'actualité une détection proactive des contenus haineux.

* 16 Faits visés par les articles 24 et 24 bis, par les deuxième et troisième alinéas de l'article 32 et par les troisième et quatrième alinéas de l'article 33 de la loi de 1881.

* 17 Disposition introduite par la loi n° 2007-297 du 5 mars 2007 relative à la prévention de la délinquance.

* 18 Porté initialement par Facebook, Twitter, Google et Microsoft, les acteurs français Dailymotion et jeuxvideos.com y ont ensuite adhéré.

* 19 Cette recommandation fait suite à la publication, en septembre 2017, d'une communication intitulée « Lutter contre le contenu illicite en ligne ».

* 20 Article 28 ter de la directive 2010/13/UE visant à la coordination de certaines dispositions législatives, réglementaires et administratives des États membres relatives à la fourniture de services et médias audiovisuels telle que modifiée par la directive (UE) 2018/1808 du 14 novembre 2018.

* 21 Proposition formulée par la Commission européenne le 12 septembre 2018.

* 22 Cette charte a été signée par tous les pays du G7 à l'exception des États-Unis. Parmi les entreprises, on peut relever la signature par Facebook, Microsoft, Twitter et Youtube. Les signataires s'y engagent « à faire tout ce qui est en (leur) pouvoir pour lutter de manière proportionnée contre les contenus illégaux, et à oeuvrer en faveur d'un internet libre, ouvert et sûr ». L'objectif n° 3 est de « protéger les personnes et groupes ciblés par les propos haineux en ligne ».